|

|

hi188| 编辑 ; q/ ^" `+ ^3 v+ Q

你见过最小的相机是多大,你见过的最小的3D深度传感器又是多大?

, G! `6 d/ p2 u8 }& B$ A1 h6 K根据哈佛大学工程和应用科学学院(SEAS)消息,该学院教授Federico Capasso带领的研发小组研发出一款利用超透镜(超薄的纳米光子组件)的深度传感器,其特点是可一次完成场景内所有深度信息测量,而且体积还很小巧,未来应用场景包括:微型机器人、侵入式医疗设备、小型穿戴设备、轻便型AR眼镜/VR眼镜等产品。

: E$ r+ d- N8 m( x当前,该论文也已在美国国家科学院院刊上进行发表,下面我们就来一探究竟。" z8 F6 {$ m0 U! X% m9 ]! h

3D传感器的进化! S9 ^. g3 E5 s& g) y

目前应用到3D和深度传感器的产品有很多,包括微软Xbox Kinect体感设备,其可识别人体动作从而实现各类的体验游戏操作,主要是游戏娱乐方面;而最新的Azure Kinect DK也正式面向各种场景,包括医疗、超市、工业3D建模等众多领域。 o6 P4 v+ H% N5 [6 y

在更大型的汽车中也有更多的车型支持,尤其是在自动驾驶车辆中,3D摄像头、LiDAR激光雷达等等,主要是用于车辆周围环境的探测与感知。5 W; U4 a3 p5 d

/ i- n, t) ^9 |( W' C( A最常见的还是在智能手机中,例如苹果iPhone X系列就是采用了3D结构光方案,安卓设备也有很多采用ToF方案,他们更注重要的还是用于3D化人脸识别的加密解密操作。5 _/ K; R2 h& n: m

不过,现有的这些产品,以智能手机为例,其能提供较大容量的电池和较高算力的芯片,因此不用担心功耗和性能不足等问题。7 d3 W3 z% @' B

但对于那些对功率和算力都有限的设备来说,例如超小型机器人、或智能手表等产品。他们如何解决3D传感器的这些限制呢?- m/ e7 ?0 a; ]# V: j3 E( \: M0 b

哈佛物理系博士候选人、论文第一作者Zhujun Shi表示:"当前的光学和视觉方案已经种类繁多,他们基本上都是为不同的产品量身定制,而纳米技术与光学设计结合,将有助于探索人造深度传感器和视觉方案。

! l* j( k" p$ M而这里提到的就是将超透镜与超高效的算法相结合,即可一次完成深度测量。( k4 W" `- z' n4 g. F' q5 A

: ^( L+ R' T7 ]( Y4 k受跳动的蜘蛛所启发: K. G. ?$ L5 B' Z

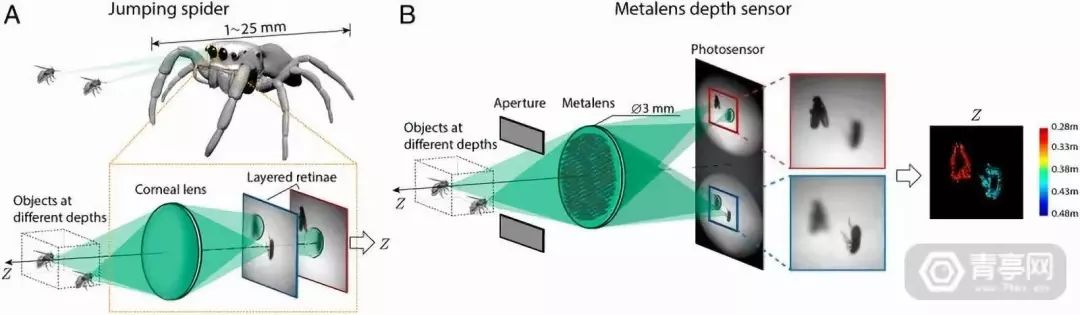

人眼和多数深度传感器获得深度信息的方法是,将左右眼(或传感器)同时拍摄的两幅略有差异的图像进行搜索对比,PS:可以将手指放在面前,交替睁开左右眼,这时你就有体会了吧。

+ h; J9 \6 v) S3 y因为需要将两张图片进行比对,这种方法实际还是很繁琐的,人类有一个强大的大脑可以处理这些任务,但是蜘蛛却没有。6 {* Z4 @7 W. x, x+ y

- d3 o( n' `0 B# B8 K3 ~) J7 P经研究发现,蜘蛛已经进化出一个有效的深度感知系统,这能够让它们准确地跳跃到是自己身躯几倍远的地方,并对毫无戒备的目标发起攻击。9 _( a: K- l; L! ]2 i. g: \) E

; R/ g% I. g5 n, E从上图了解到,如果蜘蛛用主眼注视着一个苍蝇,这时只有主眼视网膜的图像是清晰的,而另一只眼镜视网膜上的图像会显得模糊,这种模糊变化的背后则直接隐藏着蜘蛛飞行距离的信息。% y S' e' k6 w2 g, c( H

在计算机视觉系统中,类似这种深度计算方法被称作:离焦深度测量法。5 M( C0 y$ R5 c5 B2 E/ |" }. w0 c

而目前,想要用现代设备复制这种方法也可以实现,但是需要大型光学摄像头和电动机械组件,这样摄像头可以拍摄不同焦点的图片,不过这也限制了传感器的速度和实际应用场景。

4 v, h6 U: j/ [0 d ~3 p' B而这就是超透镜发挥优势的地方。( R0 Y( {) \/ d- R9 \

实验室研究和结果5 i1 k0 o Y8 e; j$ q; Z2 I4 i

! @2 R$ Q/ J* }+ Z ! @2 R$ Q/ J* }+ Z

在实验中,该研究小组尝试将两个具有不同深度焦距的离轴透镜共同放到一个光圈中。: Y, p0 |. C% F' W

4 G4 w9 R! ^ z- j' U 4 G4 w9 R! ^ z- j' U

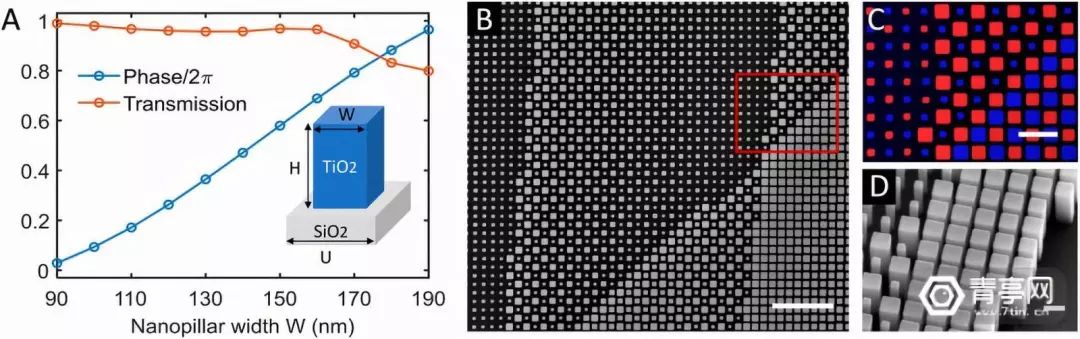

上图即超透镜设计方案,a表示传输效率和相移与纳米柱宽度函数图;b表示超透镜俯视显微镜图像,比例尺2um;c表示b图中红色标注区域放大,展示了空间复用方案效果以及不同颜色的显示,比例尺500nm;d表示超透镜轮廓的显微镜图像,比利时:200nm。

5 r, `0 h. k: L y/ e* q基于此元件和现有的组件进行结合,从而构建出一个超透镜深度传感器原型,包括光学组件和机械组件的原型体积为4×4×10cm。当然这个体积算不上小,但由于超透镜材料直径仅3mm,如果采用专用光电传感器则可大大降低整个传感器原型的尺寸。" s6 W0 K: B9 |! ^- j

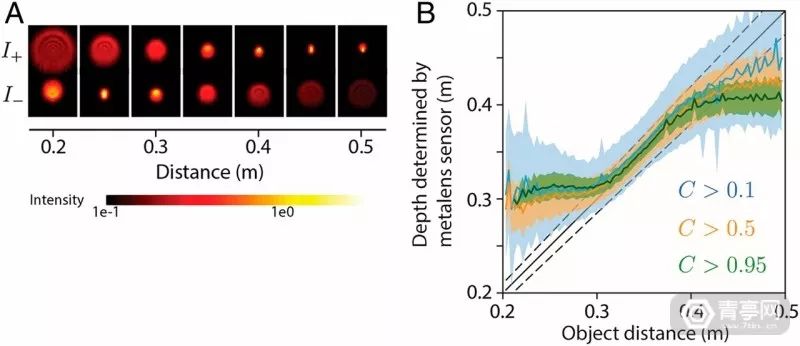

+ q) n$ A% d8 H3 F上图a展示了不同距离下LED光源拍摄到的两幅图像模糊程度的变化,b是超透镜传感器深度作为物距的已知函数。

6 e" E, E- H# x6 Y1 J% z, Q) R% C , ~& Y) o6 e$ X. O , ~& Y) o6 e$ X. O

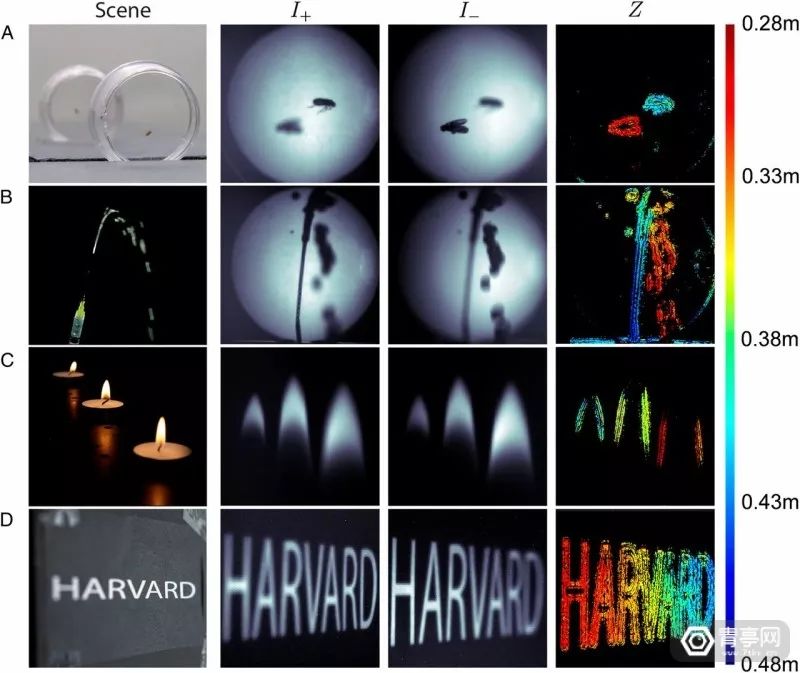

上图为各种场景下的深度图像展示,因为超透镜一次拍摄的方案,因此这种方案可以拍摄快速移动的物理。a是移动的果蝇;b是动态的水柱;c是半透明类的效果,烛光(这类往往无法通过激光雷达或ToF测量);d是印刷效果的文本的倾斜视角图像,深度信息均匀。

' Y1 a3 n- d/ p. x/ ?, g& T6 o' n, ~8 E4 ]) F" N

上图是位于不同位置的蜡烛,所展现出的深度图像效果。

7 X+ a5 r. K8 H* o5 U, H1 ]实验室内采用了由英特尔i5-8500K处理器和NVIDIA Titan V显卡构成的计算机进行每秒100帧以上的速度生成400×400分辨率的深度图像,而且通过优化代码和硬件部分,还可以进一步提升速度。综合每个输出的像素产生速度图的值需要637 个FLOP,仅涉及25×25的周围像素,对比来看常规的双目立体算法有效输出每个像素约需7000个FLOP,另外知名光流算法Lucas-Kanade则需要2500个FLOP。; L4 s R* n0 x* Z2 n4 k$ U% z) z, f

最终,根据实验室的一系列测试,超透镜深度传感器基本被初步证实具备:体积小、重量轻、算力需求小、单个组件等优势,未来这种将纳米光子学和高效算法结合的深度测量方案有望应用在微瓦级这种昆虫规模的平台上,例如微型机器人、可食入人体的传感设备等等。2 g, N1 v: A& j$ Q6 N9 k! [

论文作者:

5 t. U1 {- a" I0 j$ J# }9 ?: GQi Guoa,Zhujun Shib,Yao-Wei Huanga,Emma Alexanderd,Cheng-Wei Qiuc,Federico Capassoa,Todd Zicklera。其中,Federico Capassoa教授也是Metalenz公司(专注于超材料技术的公司)联合创始人。

. _, A0 H* R; c- R9 b% `来源:' j# b" H( l$ U) w% O) M

https://www.pnas.org/content/early/2019/10/22/19121541161 v$ C) k& u- X

(END)

' `5 L4 @% h5 D

4 {$ r+ H1 P' n, N; E' G% t! ? 推荐阅读

; {9 o) k$ `6 u& D1 C8 c! `3 m5 j, v& G; R- A# c- P0 ^

7 y" {9 a ~( H1 k

; t, V I& m) R$ s* M# f: q, P8 F% P7 t* f6 ^+ O# {* @2 W

5 F* h8 t* G+ P! D2 k+ Z+ _# y6 o+ G7 g: e: q2 N* q' ~

; \2 ~* v9 j2 ]

) }4 k# Z4 r# G$ H 每天五分钟,轻松了解前沿科技。 每天五分钟,轻松了解前沿科技。

1 L5 {& z+ e* L/ x —— 青亭网

/ M9 ^) o& M& {: }1 \来源:http://mp.weixin.qq.com/s?src=11×tamp=1572359405&ver=1942&signature=i-isN2TKvG1kxC7PKoHIeZBhtBaUA-iCPs7eC*Bw697z0XV*SSO84QBjPBfRRgiQVLF9Hd79gLYYhwWJIXAeToJptjyIA4lKoPVfC5CTeyF4LWBKAtrx13hHCMDZLP7p&new=1

" N9 h) X5 y4 U! P: X0 C/ a" D免责声明:如果侵犯了您的权益,请联系站长,我们会及时删除侵权内容,谢谢合作! |

本帖子中包含更多资源

您需要 登录 才可以下载或查看,没有账号?立即注册

×

|

|手机版|小黑屋|梦想之都-俊月星空

( 粤ICP备18056059号 )|网站地图

|手机版|小黑屋|梦想之都-俊月星空

( 粤ICP备18056059号 )|网站地图